福島県母畑温泉で開催された情報処理学会 マルチメディア,分散,協調とモバイルシンポジウム(DICOMO 2025)にて下記の2件の発表を行い,志田原さんが優秀プレゼンテーション賞を受賞しました.

- 高野耀希,長瀬清之助,辻愛里,藤波香織.能動学習を活用した組み立て作業中の迷い推定システムの個人化,マルチメディア,分散,協調とモバイルシンポジウム(DICOMO2025),pp. 497-507, 2025年6月25日.

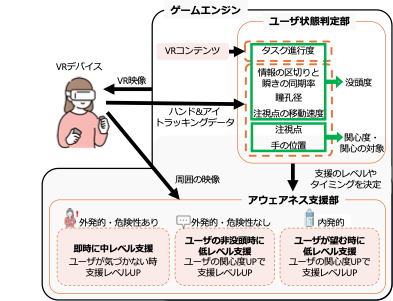

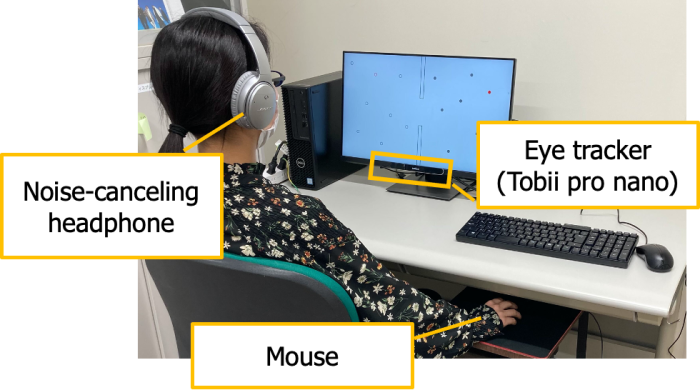

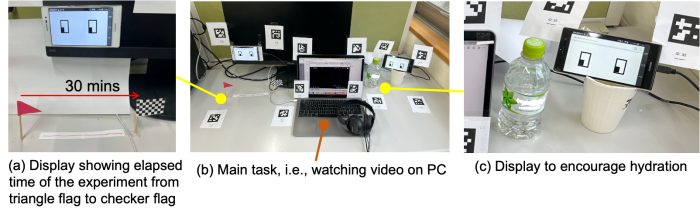

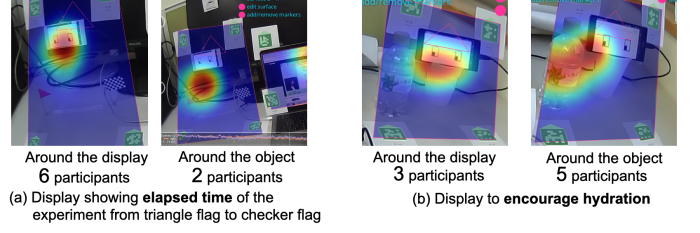

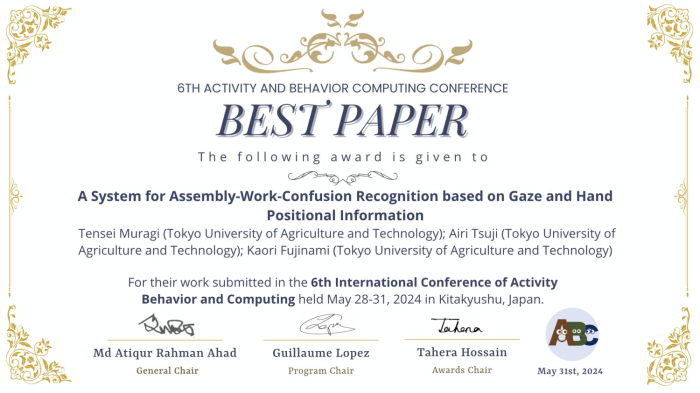

【概要】近年,製造現場では手作業の組み立て作業を情報技術で支援する有用性が示されていますが,作業者の状態を無視した支援は意欲低下を招くという報告があります.我々の先行研究で,作業者の状態として視線と手の位置による迷い推定手法を提案し,個人化モデルが推定精度向上に有効であることを示唆しました. この発表では迷い推定システムの個人化手法として能動学習に着目し,推定精度への個人差の影響低減を目指しました.また,状態に応じた支援設計に関する知見を得るため,システム長期使用時のユーザビリティや作業者への影響を定量的に評価しました.結果として,能動学習による個人差の影響低減は確認されず,適切な特徴量・分類モデルの再選定が必要であることが分かりました.さらに,推定結果提示のユーザへの影響やシステムの改善点も明らかにしました.

- 志田原萌美,藤波香織.装着型慣性センサを用いた作業時のメンタルワークロード推定〜床拭き掃除のケース〜,マルチメディア,分散,協調とモバイルシンポジウム(DICOMO2025),pp. 748-758, 2025年6月26日.

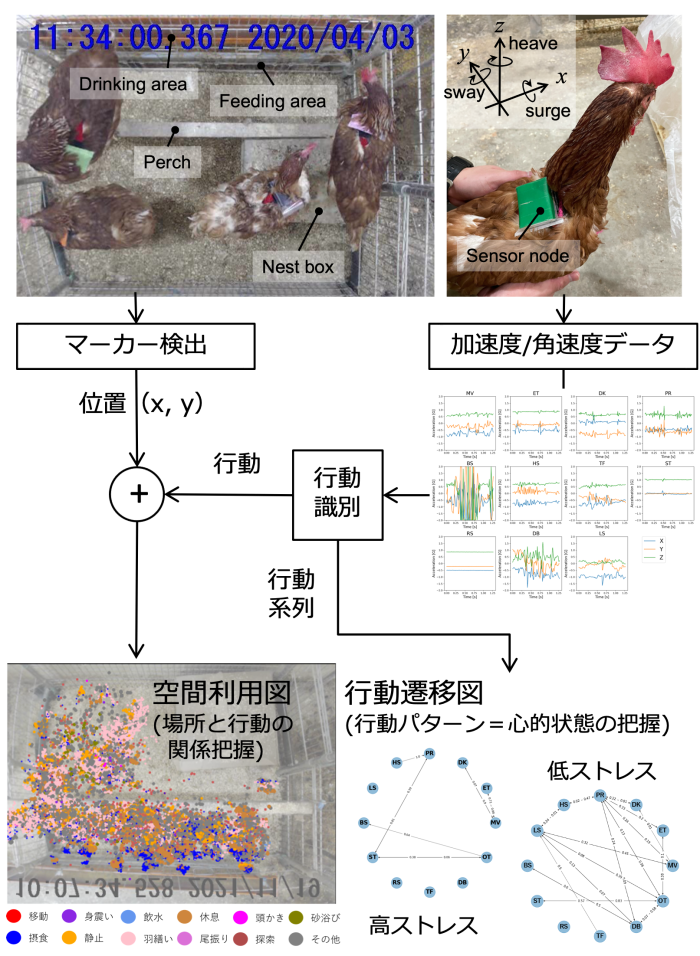

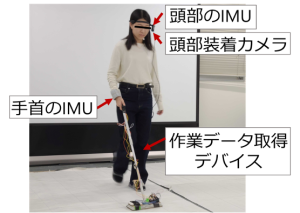

【概要】ワーキングメモリにかかる認知負荷量をメンタルワークロード(MWL)といい,過負荷時には注意力の散漫によりヒューマンエラーが発生しやすいとされます.また,慢性的な負荷が食欲の増加や睡眠の質に影響することが分かっており,ヘルスケアに影響する可能性もあります.そこで日々のMWLの推定やリアルタイムかつ客観的な推定が重要となります.本研究では床拭き掃除をケーススタディとして,その最中の身体と道具の慣性データによるMWL推定手法を検討しました.我々の先行研究では,固定長時間区間(ウィンドウ)内のデータから平均や分散,周波数成分の算出した基本特徴量を用いた推定の有効性を確認していましたが,本発表では記号列特徴量と呼ぶ新たな特徴量を導入してその単体の有効性や基本特徴量との組み合わせの有効性を検証しました.記号化特徴量は,慣性センサの生データから算出した多次元情報をベクトル量子化により変換した記号列に対して,記号間の遷移や出現頻度などを算出して特徴量とするものです.基本特徴量と記号化特徴量の統合により推定精度が最も向上することを確認しました.また特徴量の算出時間の点からは,基本特徴量のみを用いることが良いことを実験的に示しました.